L’analyse multi-modale exploite plusieurs types de données (texte, image, son) simultanément pour des insights plus riches. Elle transforme la data science en combinant sources diverses, ouvrant la voie à des applications IA plus puissantes et pertinentes.

3 principaux points à retenir.

- Multi-modalité : fusionner différents types de données pour un regard plus complet.

- Applications IA : amélioration notable en reconnaissance, prédiction et génération de contenu.

- Complexité technique : demande architecture spécifique, traitement adapté, mais donne un avantage concurrentiel.

Qu’est-ce que l’analyse multi-modale des données ?

L’analyse multi-modale des données, c’est quoi au juste ? Imaginez un processus qui fusionne des informations textuelles, audio, vidéo et images en un seul ensemble cohérent. C’est exactement ce que l’on appelle l’analyse multi-modale. Contrairement aux approches traditionnelles qui se concentrent sur une seule modalité (une seule source de données, par exemple uniquement des textes ou des vidéos), l’analyse multi-modale exploite la richesse d’informations qu’offre cette diversité. Cela corrobore ce que disent les experts : « L’intégration des modalités offre une vue d’ensemble que aucune analyse mono-modale ne peut fournir. » (source : Snowflake).

Pourquoi est-ce crucial dans notre monde moderne de la data science et de l’intelligence artificielle ? Tout simplement parce que les enjeux d’aujourd’hui nécessitent une compréhension multidimensionnelle. Prenez par exemple la combinaison de la vision par ordinateur (qui traite des images) et du traitement du langage naturel (qui s’occupe des textes). Lorsque vous intégrez ces deux approches, vous ne vous contentez pas d’identifier un objet dans une image ; vous pouvez aussi comprendre la signification des mots qui y sont liés, offrant ainsi une expérience utilisateur plus riche et plus pertinente.

Les modèles génératifs multi-modaux, tels que DALL-E et CLIP, illustrent également l’efficacité de cette approche. Ces modèles peuvent créer des images à partir de descriptions textuelles ou vice versa, en s’appuyant sur un large éventail de données pour produire des résultats créatifs et utiles.

En résumé, l’analyse multi-modale va bien au-delà des analyses traditionnelles. Elle permet d’établir des corrélations, d’identifier des tendances inédites et d’obtenir des résultats plus précis. Voici un tableau qui résume les types de données multi-modales et leurs bénéfices respectifs :

| Type de données | Bénéfices |

|---|---|

| Texte | Compréhension du contexte et des sentiments |

| Audio | Analyse des émotions et tonalités |

| Vidéo | Interprétation dynamique des mouvements et scénarios |

| Images | Identification et classification visuelle |

Pourquoi l’analyse multi-modale est-elle un atout en IA et data ?

L’analyse multi-modale est un véritable game changer dans le monde de l’IA et de la data science. La clé ici, c’est la combinaison de différentes sources de données – texte, images, audio, etc. – pour améliorer la pertinence et la précision des modèles d’IA. Pourquoi ? Parce qu’un modèle qui puise dans plusieurs types de données capte une approche plus globale d’une situation ou d’un phénomène, offrant ainsi une meilleure compréhension contextuelle.

Considérons les Generative Adversarial Networks (GAN) multi-modaux. Ces systèmes évoluent grâce à des données hétérogènes, apprenant à générer du contenu qui allie différentes modalités. Par exemple, un GAN peut utiliser des images et des descriptions textuelles pour créer des visuels cohérents avec le message verbal. Cela renforce la robustesse des prédictions, car le modèle s’appuie sur plusieurs éléments pour tirer des conclusions, ce qui minimise les biais d’une source unique.

Regardons un autre exemple avec CLIP (Contrastive Language–Image Pre-training) d’OpenAI. Ce modèle est capable de comprendre les relations entre images et textes. Cela transforme la manière dont on interroge et exploite les données. La capacité à interpréter des requêtes textuelles et à les associer directement à des visuels donne lieu à une meilleure généralisation des modèles, permettant des applications variées – de la recherche d’images à la création de contenus multimédias adaptés.

Cependant, il y a des défis à relever. Synchroniser et aligner temporellement des données provenant de différentes sources n’est pas trivial. Vous devez vous assurer que les données d’image et de texte, par exemple, se réfèrent effectivement au même sujet. Cela nécessite des efforts conséquents au niveau de l’ingénierie des données et de la validation des résultats obtenus.

Dans les workflows modernes d’automatisation et de machine learning, intégrer une approche multi-modale nécessite des systèmes flexibles capables de gérer diverses entrées tout en maintenant une cohérence. Cela passe par des pipelines de traitement de données robustes, permettant à chaque mode de contribuer de manière significative à l’entraînement du modèle. À terme, ceux qui adoptent cette dynamique multi-modale se placeront à la pointe de l’innovation.

Comment mettre en place l’analyse multi-modale dans un projet ?

Pour mettre en place une analyse multi-modale dans un projet, il est crucial de suivre des étapes bien définies afin d’éviter la confusion et le chaos inhérents aux données provenant de multiples sources.

- Collecte des données : C’est la première étape clé. Vous devez rassembler différentes modalités d’informations, qu’il s’agisse de données textuelles, d’images ou même de son. Pensez à la variété : des tweets aux vidéos, chaque type de donnée apporte une dimension unique à l’analyse.

- Prétraitement spécifique à chaque modalité : Ici, il s’agit d’extraire des caractéristiques pertinentes en fonction du type de données. Pour du texte, on peut utiliser la tokenisation et l’analyse de sentiment. Pour les images, le redimensionnement et l’extraction de caractéristiques via des CNN sont essentiels.

- Fusion des données : Vous avez plusieurs options ici – fusion précoce (avant l’apprentissage), intermédiaire (après l’extraction des caractéristiques) ou tardive (après la prise de décision). Le choix dépend du problème spécifique. La fusion précoce est généralement plus efficace, mais elle exige des données compatibles.

- Choix des modèles adaptés : Optez pour des modèles hybrides, par exemple une combinaison de réseaux de neurones convolutifs pour les images et de transformateurs pour le texte. Ces architectures permettent une meilleure compréhension par le modèle des interactions entre différentes modalités.

Voici un exemple de code simple en Python pour fusionner des données textuelles et d’images. Cet exemple utilise TensorFlow et Keras :

import numpy as np

import tensorflow as tf

from tensorflow.keras.models import Model

from tensorflow.keras.layers import Input, Dense, Flatten

# Input pour les images

image_input = Input(shape=(64, 64, 3))

x = Flatten()(image_input)

image_output = Dense(128, activation='relu')(x)

# Input pour le texte

text_input = Input(shape=(100,))

y = Dense(128, activation='relu')(text_input)

# Fusion des sorties

combined = tf.keras.layers.add([image_output, y])

z = Dense(10, activation='softmax')(combined)

model = Model(inputs=[image_input, text_input], outputs=z)

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

Ce code démontre la création d’un modèle qui fusionne les données d’images et de texte dans une seule architecture. Les outils comme TensorFlow et PyTorch (en particulier PyTorch multimodal) facilitent énormément cette tâche. Pour la gestion des données, des frameworks comme LangChain pour la recherche augmentée par la génération (RAG) peuvent également être intégrés.

Enfin, une infrastructure adaptée est essentielle. Un stockage performant et des capacités de calcul suffisantes sont nécessaires pour traiter des volumes de données élevés sans goulots d’étranglement. En suivant ces bonnes pratiques, vous pourrez tirer profit de la complexité des données multi-sources sans tomber dans le chaos. La clé réside dans une planification rigoureuse et une exécution soignée dès le départ.

Quels sont les défis et limites de l’analyse multi-modale ?

L’analyse multi-modale, bien que prometteuse, n’est pas sans défis. Voici les principaux obstacles à surmonter pour en tirer pleinement parti :

- Complexité computationnelle : L’intégration de plusieurs types de données exige une puissance de calcul considérable. Par exemple, un modèle qui combine du texte, des images et des sons nécessite des algorithmes sophistiqués. Ce coût en ressources peut dépasser celui des analyses unidimensionnelles, limitant son utilisation à des infrastructures avancées.

- Alignement des données multimodales : Synchroniser différents types de données dans le temps et l’espace est un casse-tête. Par exemple, si vous travaillez avec des vidéos et des transcriptions, il faut s’assurer que chaque segment de texte correspond au bon moment dans la vidéo. Des méthodes comme les réseaux de neurones récurrents peuvent aider, mais n’éliminent pas totalement le problème.

- Gestion du bruit : Les données issues de diverses sources sont souvent entachées d’erreurs ou de bruit. Quand plusieurs modalités sont mélangées, ces imperfections peuvent fausser les résultats. La détection et la correction du bruit dans chaque modalité sont essentielles, mais cela s’avère parfois complexe.

- Besoins en données de qualité : Chaque modalité doit être de haute qualité pour obtenir des résultats fiables. Si l’une d’entre elles est incomplète ou biaisée, cela compromet toute l’analyse. Des études révèlent que 70% des projets d’IA échouent à cause de données de mauvaise qualité (source : McKinsey).

- Surcharge d’information : L’intégration de multiples modalités peut entraîner une surcharge de données, augmentant le risque d’overfitting. Les modèles deviennent trop complexes, entraînant une mauvaise généralisation sur de nouvelles données. Un bon processus de validation et de régularisation est donc nécessaire.

Au-delà des défis techniques, il existe des considérations éthiques. La combinaison de données personnelles sensibles dans plusieurs formats soulève des questions sur le respect de la vie privée et la conformité au RGPD. Les entreprises doivent garantir la transparence et la sécurité des données pour éviter des sanctions sévères.

Pour contourner ces obstacles, voici quelques bonnes pratiques :

- Gérer rigoureusement les pipelines de données : Utilisez des outils de gestion des données pour contrôler chaque étape de l’analyse.

- Collaborer pluridisciplinairement : Faites intervenir des experts en data science, éthique et juridique pour assurer une approche intégrée.

- Utiliser des techniques de prétraitement : Filtrez et préparez vos données avant l’analyse pour améliorer leur qualité.

En intégrant ces pratiques, vous pouvez maximiser l’efficacité de vos projets d’analyse multi-modale tout en respectant les normes éthiques. Pour approfondir ce sujet, vous pouvez consulter cet article sur l’intelligence artificielle multimodale ici.

Comment tirer le meilleur parti de l’analyse multi-modale aujourd’hui ?

L’analyse multi-modale n’est plus une option mais un levier stratégique en data science et IA. Elle offre une compréhension plus riche et des performances accrues, en combinant intelligemment données images, texte, audio et plus. Cependant, elle exige une expertise technique pointue et une infrastructure solide. Pour réussir, alignez vos objectifs business avec une architecture adaptée, équipez-vous d’outils modernes et ne négligez ni la qualité des données ni les aspects éthiques et réglementaires associés. Le multi-modal ouvre une nouvelle dimension, mais le vrai défi est dans sa mise en œuvre pragmatique et maîtrisée.

FAQ

Qu’est-ce que la donnée multi-modale ?

Quels avantages offre l’analyse multi-modale ?

Quels sont les défis techniques de cette approche ?

Quels outils utiliser pour l’analyse multi-modale ?

L’analyse multi-modale pose-t-elle des enjeux éthiques ?

A propos de l’auteur

Franck Scandolera, expert en analytics engineer et formateur depuis plus de dix ans, déploie et automatise des infrastructures data complexes intégrant IA générative et pipelines multi-sources. Avec webAnalyste et Formations Analytics, il accompagne les professionnels dans la valorisation pragmatique des données, du tracking au machine learning, garantissant des solutions efficaces, conformes et adaptées aux usages métiers.

⭐ Analytics engineer, Data Analyst et Automatisation IA indépendant ⭐

- Ref clients : Logis Hôtel, Yelloh Village, BazarChic, Fédération Football Français, Texdecor…

Mon terrain de jeu :

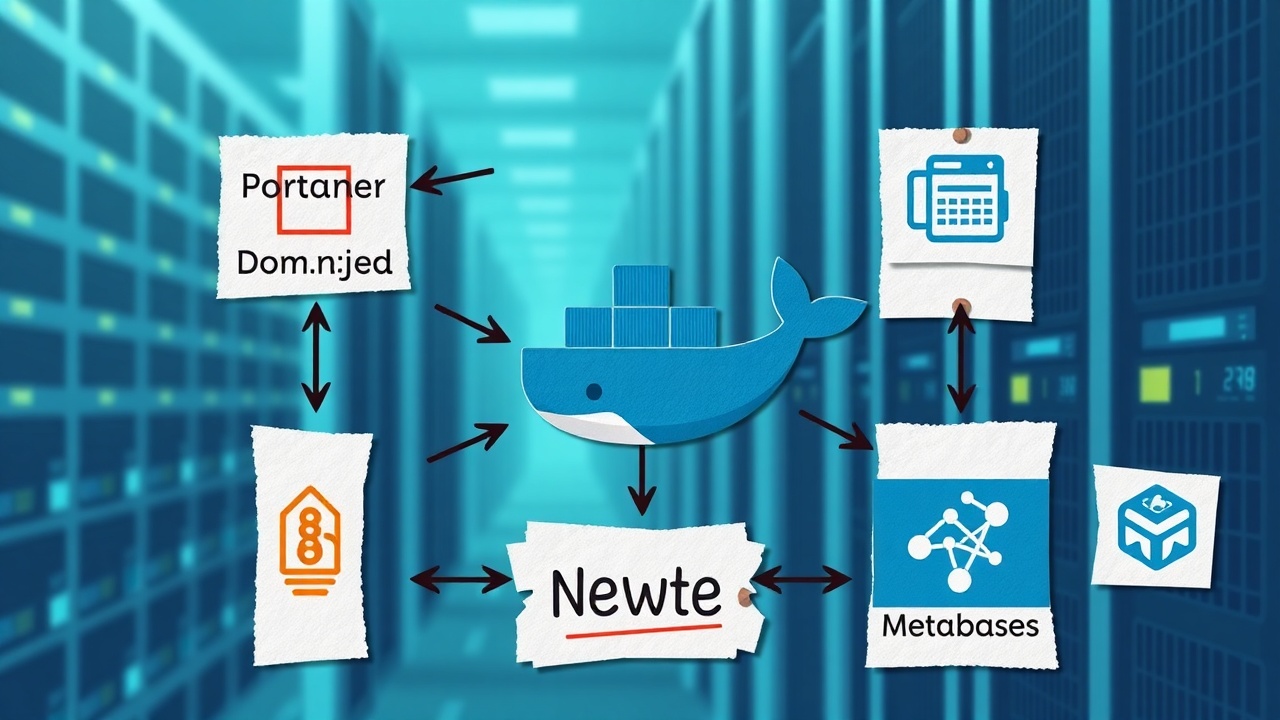

- Data Analyst & Analytics engineering : tracking avancé (GTM server, e-commerce, CAPI, RGPD), entrepôt de données (BigQuery, Snowflake, PostgreSQL, ClickHouse), modèles (Airflow, dbt, Dataform), dashboards décisionnels (Looker, Power BI, Metabase, SQL, Python).

- Automatisation IA des taches Data, Marketing, RH, compta etc : conception de workflows intelligents robustes (n8n, App Script, scraping) connectés aux API de vos outils et LLM (OpenAI, Mistral, Claude…).

- Engineering IA pour créer des applications et agent IA sur mesure : intégration de LLM (OpenAI, Mistral…), RAG, assistants métier, génération de documents complexes, APIs, backends Node.js/Python.